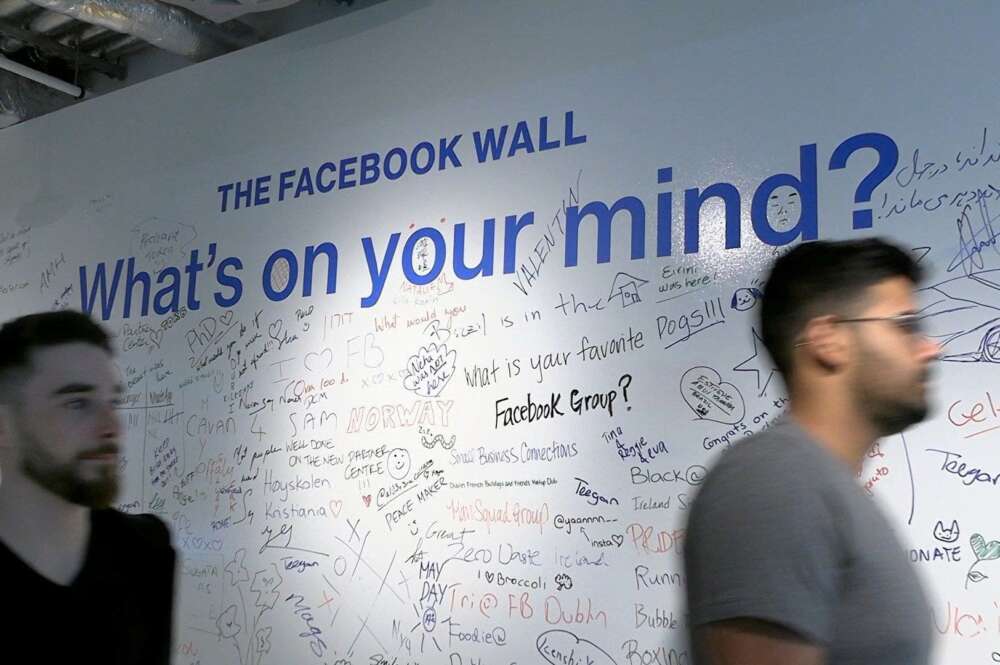

El contenido nocivo de Facebook pasa factura a sus moderadores

El reto de vigilar los contenidos de Facebook da paso a un campo de trabajo inédito que desgasta la salud mental de los moderadores

Existen estudios que vinculan el uso de las redes sociales y la depresión, y hasta Facebook ha admitido ya su culpa en el detrimento de la salud mental. Pero el oscuro mundo que se erige a través de la plataforma de Mark Zuckerberg no pasa factura únicamente a los usuarios, sino incluso también a sus trabajadores, especialmente a aquellos encargados de moderar los turbios contenidos de la red social.

Facebook tiene miles de moderadores alrededor del mundo. Incluso en España, en Barcelona, la tecnológica subcontrata servicios de moderación en idiomas como el portugués. El ejército de «policías» de la compañía ha incrementado como respuesta a los múltiples escándalos en los que se ha visto envuelta, acusada de no patrullar lo suficiente para evitar la viralización de contenidos nocivos y problemáticos.

Pero sus moderadores ahora empiezan a romper el silencio. Al tratarse de un campo de trabajo inexistente hasta hace algunos años, las consecuencias de este tipo de labores se han empezado a notar de un tiempo a ahora. Y son nefastas, según explican algunos de estos trabajadores –en condición de anonimato por los acuerdos de confidencialidad de Facebook–, en declaraciones recogidas por The Guardian.

Algunos miembros del equipo de moderación de Facebook describen sentirse molidos por el volumen de trabajo (en casos, han sido obligados a revisar hasta 1.000 piezas de contenido por día), la violencia gráfica del material que deben vigilar constantemente, la desnudez y explotación sexual presente en ciertos círculos, y los actos de intimidación que observan todos los días, encima por «prácticamente un salario mínimo».

«Somos una especie de vanguardia en este campo», dijo un exmoderador de Facebook llamado Daniel. «Es un trabajo completamente nuevo, y todo es básicamente un experimento», añadió. «Creo que es importante abrir un debate sobre este trabajo. Necesitamos compartir nuestras historias, porque la gente no sabe nada de nosotros, de nuestro trabajo, de lo que hacemos para ganarnos la vida», comentó su excompañero, John.

Los moderadores de Facebook se radicalizan ante tantas ‘fake news’

Algunos moderadores de Facebook cuentan cómo han visto a compañeros radicalizar sus posturas ideológicas después de estar constantemente expuestos a contenidos falsos de la ultraderecha. Otros han admitido tornarse amargados tras constatar la gran cantidad de abusos a menores de edad que se vive en grupos y chats privados en la red social. Y unos lamentan que recurren a las drogas para aliviar el estrés.

«Tenemos hombres blancos ricos de Europa, de los Estados Unidos, que escriben a niños de Filipinas… e intentan obtener fotos sexuales a cambio de 10 o 20 dólares», dijo uno de los moderadores. «Entiendes algo más sobre este tipo de sociedad distópica que estamos construyendo todos los días», apostilló, tras anotar que «el 90%» de los chats problemáticos que revisan son de índole sexual.

La propaganda también puede terminar afectando a los «policías» de Facebook. «Quizás porque todo este discurso de odio que tenemos que enfrentar todos los días afecta de alguna manera nuestra visión política», explicó uno de los moderadores. «Una persona liberal, tal vez también una persona progresista, puede volverse más conservadora, más preocupada por temas como los migrantes, por ejemplo».

«De hecho, muchos de los contenidos de discurso de odio que recibimos diariamente son noticias falsas… que tienen como objetivo compartir puntos de vista políticos muy particulares», añadió. Los ha habido casos de moderadores de Facebook que han adquirido armas por miedo a encontrarse en la calle rodeados de inmigrantes, por ejemplo. También se habla de moderadores convertidos a la ultraderecha tras unos meses.

Facebook respondió a The Guardian diciendo que «los moderadores de contenido realizan un trabajo vital para mantener segura a nuestra comunidad, y nosotros asumimos nuestra responsabilidad de garantizar su bienestar. Trabajamos (…) para garantizar que brinden el apoyo que las personas necesitan, incluida la capacitación, el apoyo psicológico y la tecnología para limitar su exposición al contenido gráfico».

Estos testimonios salen a la luz unos meses después de que The Verge investigara algunos equipos de moderación de Facebook y encontrara que la mayoría de estos trabajadores hacen lo suyo en condiciones «indescriptiblemente estresantes», según uno de esos moderadores. Otro reportaje del mismo medio en febrero advirtió de que están «continuamente expuestos a violencia gráfica y a explotación infantil».

En mayo pasado, el moderador de Facebook, Keith Utley, murió en su puesto de trabajo por un paro cardíaco. El caso arrojó nuevas sombras acerca de las condiciones y el estrés que supone lidiar con «el lado pernicioso de la humanidad», en palabras de la vicepresidenta de marketing de la red social, Carolyn Everson, que en junio admitió que el problema de la moderación «no tiene solución del todo».